ABSTRACT

Il contributo esamina l’impiego della computazione algoritmica nelle funzioni di protezione della sicurezza pubblica e di prevenzione e repressione del crimine. Tale settore risulta particolarmente vitale per il perseguimento della sicurezza e del decoro urbano, ma richiede un’appropriata governance dei dati e degli strumenti algoritmici di analisi, soprattutto nei casi di processi decisionali automatizzati, per tutelare la dignità ed il pieno sviluppo della persona, garantendo l’eguaglianza e la non discriminazione. Per tali ragioni, l’analisi dell’impatto dell’intelligenza artificiale e delle principali ricadute critiche di natura giuridica offre validi spunti per meditare brevi premesse metodologiche per la governance degli algoritmi e per l’implementazione delle politiche pubbliche nel settore della sicurezza pubblica.

Alessia PALLADINO, Dottore di ricerca in Humanities and Technologies: an integrated research path Università degli studi Suor Orsola Benincasa Napoli

Paper

La governance degli algoritmi di intelligenza artificiale tra tutela della sicurezza e dei diritti fondamentali

- 1. La datizzazione della sicurezza nell’era delle smart cities

La dirompente innovazione tecnologicadi matrice informatica e comunicativa[1] manifestatasi sin dagliesordi del Ventunesimo secolo[2] ha indotto una profonda rimeditazione dell’assetto morfologico, sociale ed economico dell’ambiente urbano, in favore dei più innovativi paradigmi della smart citye della global city[3]. La crescente fruibilità dei servizi di telecomunicazione e di nuovi dispositivi capaci di connettersi in tempo reale[4] – ovvero di interconnettersi, come nel caso dell’Internet of Things[5] –si insinua nel tessuto urbano, sintesi dei conflitti e delle istanze di tutela dei diritti fondamentali, portando a una piena datification[6] della società stessa.

La città, in sintesi, rappresenta un’essential facility[7] per la raccolta ed elaborazione dei cd. Big Data[8], ingente ed eterogenea quantità di dati, sottoposta ad innovativi processi di analisi per l’emersione delle più recondite interconnessioni tra dati[9]. L’analisi dei Big Data consente dunque di ricavare nuove conoscenze, rispetto a quelle insite nel dato stesso, senza che siano necessariamente predefiniti l’oggetto di indagine e gli obiettivi perseguiti[10].

Sebbene il fenomeno rifugga ad una precisa ricostruzione definitoria[11] e normativa[12], i Big Data nutrono i più moderni modelli di analisi basati sull’intelligenza artificiale, il cui uso (originariamente invalso soltanto nel mercato)[13] riscontra crescente applicazione nel settore pubblico[14]. Tra le più svariate manifestazioni dell’agire pubblico, l’impiego della computazione algoritmica nelle funzioni di protezione della sicurezza pubblica e di prevenzione e repressione del crimine merita particolare attenzione.

L’intelligenza artificiale si propone in tal caso come supporto versatile, in grado di fornire previsioni sulla verificazione di eventi futuri e dannosi – per neutralizzarne efficacemente gli effetti negativi –[15], ma anche di candidarsi a vero e proprio meccanismo decisionale (Automated Decision Making[16]). Echeggiano, a tal proposito, le più recenti esperienze di Big Data Policing[17] maturate nel contesto europeo e statunitense, cogitanti sistemi algoritmici per la più efficace ed efficiente previsione dei reati[18], basati su meccanismi di “partecipazione civica” ai meccanismi previsionali[19], nonché algoritmi che supportano il processo decisionale giudiziario[20].

Calato nel contesto nostrano, un simile scenario operativo non risulta utopico, se confrontato con i più recenti orientamenti in materia di sicurezza urbana integrata[21]: gli ultimi approdi normativi[22], invero, restituiscono una nuova morfologia dell’ambiente urbano[23], che per farsi “smart” predilige la sinergia tra azione amministrativa e strumento repressivo – sanzionatorio ai meri baluardi proattivi della “resilienza urbana”[24], confidando nell’ausilio tecnologico come mezzo facilitatore del contrasto[25]. In questo senso, la valenza predittiva degli algoritmi di intelligenza artificiale ben si concilierebbe con le più recenti e vivide istanze di contenimentoex antedei fenomeni criminosi e lesivi, trovando conferma nelle più recenti sperimentazioni operanti a livello nazionale[26].

Ciononostante, per garantire un’effettiva governance dell’algoritmo, capace di asseverare le nuove istanze di tutela senza alcuna compromissione degli ulteriori diritti fondamentali, è necessario procedere ad alcune riflessioni di ordine tecnico, empirico e giuridico.

- 2. La governance dell’algoritmo tra “Diritto alla sicurezza” alla “Sicurezza dei diritti”

Alla luce dello scenario sommariamente descritto, è necessario riflettere almeno su tre nuclei tematici.

Il primo ed il secondo si collegano alle più moderne manifestazioni di realtà amministrative algoritmiche, disvelando l’atavico dilemma insito nel rapporto tra pubblico e privato: il ricorso a sistemi di analisi proprietari, coperti da diritti di proprietà intellettuale ed industriale, opacizza i confini tra pubblico e privato che insistono sulla gestione, proprietà, e riuso dei dati e degli algoritmi decisionali, svilendo ogni istanza di intelligibilità e “spiegabilità” del processo decisionale, specialmente nei processi decisionali automatizzati[27]. L’esternalizzazione di tali servizi, nel complesso, rischia di compromettere la trasparenza dei processi decisionali, esponendo l’autorità pubblica ad una delegittimazione in caso di verificazione di errori previsionali[28]. Si pone pertanto un problema di affidabilità, correttezza e trasparenza nell’uso degli algoritmi: se non calibrati, essi potranno arrecare severi pregiudizi alle situazioni giuridiche dei destinatari; ma soprattutto, gli replicheranno l’eventuale errore per un numero potenzialmente infinito di volte, se e finché lo stesso venga accertato e corretto.

Il terzo, consequenziale, si connette al panorama normativo, attualmente vigente, in materia di protezione dati. In particolare, esaminando la Direttiva 2016/680/Ue[29] è possibile riscontrare un primo importante contemperamento rispetto alla produzione di effetti negativi derivanti eventuali processi decisionali automatizzati: dalla lettura dell’articolo 11, in effetti, il soggetto interessato destinatario della misura gode del diritto di opposizione ad una decisione basata unicamente su un trattamento automatizzato, potendo richiedere l’intervento umano nel processo decisionale. Purtuttavia, ciò non eleva gli standard di trasparenza e di tutela dei diritti fondamentali dell’interessato: in effetti, l’articolo 13, paragrafo 3, della Direttiva stabilisce che gli Stati membri possano adottare misure legislative intese a ritardare, limitare o escludere la comunicazione di informazioni all’interessato, ogniqualvolta la loro diffusione possa compromettere le indagini, la prevenzione o il perseguimento dei reati, ovvero la sicurezza pubblica e, nondimeno, i diritti e le libertà fondamentali altrui. La norma, peraltro, non consente unicamente il differimento di tali comunicazioni, ma legittima la mancata comunicazione preventiva all’interessato circa le attività di trattamento che l’autorità competente intende attuare, ogniqualvolta ciò comprometterebbe la prevenzione dei reati ovvero i diritti e le libertà fondamentali altrui: più precisamente, l’autorità pubblica potrà omettere ogni comunicazione all’interessato avente ad oggetto (i) il periodo di conservazione dei dati personali, (ii) la base giuridica per il trattamento, (iii) le categorie di destinatari dei dati personali, anche in paesi terzi o in seno a organizzazioni internazionali, ma soprattutto (iv) ulteriori informazioni, in particolare nel caso in cui i dati personali siano raccolti all’insaputa dell’interessato.

Alla luce di quanto esposto, per costruire una solida governance degli algoritmi ispirata ai principi etici e ai valori degli ordinamenti democratici, si procederà alla introduzione di un protocollo metodologico basato sulla verificazione di misure ex ante che garantiscano un uso dei dati consapevole, appropriato e responsabile.

- 3. Verso un protocollo metodologico per la governance degli algoritmi

In questo paragrafo si intende procedere a fornire talune premesse metodologiche per la governance degli algoritmi.

In particolare, occorreorientare le attività di costruzione ed applicazione dell’algoritmo alla trasparenza e alla protezione dei diritti fondamentali come presupposto metodologico fondamentale.

Per assicurare ciò, occorre ragionare anzitutto sulla tipologia di dati che si intende adoperare. L’eterogeneità dei Big Data, in effetti, non deve tradursi nel mancato rispetto della normativa rilevante in materia di protezione dei dati personali e non personali. Risulterà dirimente ragionare, per quanto strettamente connesso alla protezione dei dati personali, sul rispetto del principio di finalità del trattamento e delle condizioni di liceità.

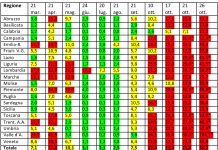

Per altro verso, occorre meditare sulla dimensione territoriale di indagine, per evitare l’impiego di strumenti di analisi modulati a seconda dei singoli contesti territoriali, favorendo eventuali disparità di trattamento tra soggetti ubicati in aree diverse.

Per favorire la trasparenza, invece, risulterebbe utile adottare soluzioni che possano essere maggiormente improntate ai canoni di trasparenza, distinguendo tra sistemi black box e sistemi clearbox. È altresì importante che la trasparenza dell’algoritmo si traduca nella necessaria comunicazione dei parametri utilizzati per effettuare l’analisi, i tempi di aggiornamento dei parametri stessi, oltre che il tipo stesso di algoritmo adoperato.

Accanto a tali suggerimenti metodologici, invero, si ritiene che la qualità del dato possa fungere da valido parametro orientativo tanto per la realizzazione dell’algoritmo, quanto per l’impiego dello stesso: la qualità del dato implica che lo stesso sia soggetto a costanti aggiornamenti, ad eventuali integrazioni o rettifiche, anche a seguito di segnalazioni provenienti da uno o più soggetti interessati. In questo senso, il principio di qualità dei dati potrebbe costituire idonea sintesi delle istanze di trasparenza e protezione dati dei consociati, assurgendo a ideale principio cardine per nella governance algoritmica.

[1] A. SCHIAVONE, Stato e cultura giuridica in Italia dall’unità alla Repubblica, Roma-Bari 1990,p.233.

[2] Per una più completa ricostruzione dell’evoluzione dell’informatica e della rete Internet, cfr. P. COSTANZO, Contributo ad una storia della libertà d’informazione: le origini di Internet (1969-1999), AA.VV., Studi in onore di Aldo Loiodice, Bari, Cacucci 2012, pp. 691-710. Cfr. anche J.B. BENIGER, Le origini della società dell’informazione. La rivoluzione del controllo, Torino, 1995. L’A. osserva come l’espressione “Società dell’informazione” risalga agli scritti di F. Machlup, pioniere negli studi economici in tema di produzione e distribuzione della conoscenza. Successivamente, tale termine è stato poi ripreso dalla Commissione europea nel Libro Bianco del 1993 “Crescita, competitività, Occupazione. Le sfide e le vie da percorrere per entrare nel XXI secolo (COM (93)700)”, volto a promuovere tra gli Stati membri politiche di sostentamento ai processi di innovazione nel settore delle tecnologie dell’informazione e della comunicazione, nonché l’implementazione di strumenti funzionali alla instaurazione di nuovi rapporti di interazione tra settore privato e pubblico, basati sullo scambio di conoscenze a livello europeo.

[3] K. POLANYI, La grande trasformazione. Le origini economiche e politiche della nostra epoca., Einaudi 1974. Per un primo approfondimento sui concetti di smart city e global city cfr. A. Algostino, Sicurezza urbana, decoro della smart city e poteri del prefetto, in Costituzionalismo.it n. 1/2019, pp. 105 e ss.

[4] M. CUNIBERTI, Tecnologie digitali e libertà politiche, in Il diritto dell’informazione e dell’informatica, fasc. 2, 2015, 275.

[5] Per un’analisi dell’Internet of things si rinvia, allo studio realizzato dalla Commissione Europea tramite la DG Communications Networks, Content & Technology nell’ambito dell’“Agenda Digitale”: COMMISSIONE EUROPEA, DG Communications Networks, Content & Technology, Definition of a Research and Innovation Policy Leveraging Cloud Computing and IoT Combination, Final Report, 2013.

[6] Sul punto, ex multis, cfr. A. STAZI, F. CORRADO, Datificazione dei rapporti socio-economici e questioni giuridiche: profili evolutivi in prospettiva comparatistica, in Il Diritto dell’informazione e dell’informatica, n.2/2019, pp.443 e ss.; V.M. SCHÖNBERGER – K. CUKIER, Big Data. Una rivoluzione che trasformerà il nostro modo di vivere e già minaccia la nostra libertà, Garzanti, Milano, 2013, p. 9 ss.; V.M. SCHÖNBERGER – T. RAMGE, Reinventare il capitalismo nell’era dei Big Data, Egea, Milano, 2018, p. 1 e ss. L’impatto del fenomeno della datification sul tessuto socio – economico globale era stato già oggetto di osservazione dall’OCSE nel 2015: Data-Driven Innovation. Big Data for Growth and Well-Being, ottobre 2015, consultabile all’indirizzo http://www.oecd.org/sti/data-driven-innovation-9789264229358-en.htm

[7] Cfr.: Case C-418/01, IMS Health GmbH 6Co. OHG v. NDC Health Gmh & Co. Kg (2004), in ECLI, UE, 2004, p. 257; Case C-7/97, Oscar Bronner Gmh& Co. KG v. Mediaprint Zeitungs-und Zeitschriftenverlag GmbH 6Co. KG, Mediaprint, in ECLI, EU, 1998, p. 569.

[8] BD. F.X. DIEBOLD, A personal perspective on the origin (s) and development of “Big Data”: the phenomenon, the term, and the discipline, PIER Working Paper No. 13-003, 2012, in https://papers.ssrn.com/sol3/papers.cfm?abstract_id=2202843.

[9] M. OREFICE, I big data. Regole e concorrenza, in Politica del Diritto n. 4/2016, pp.697 e ss.

[10] F. FAINI, Big data, algoritmi e diritto, in DPCE online, 2019/3, pp. 1871 e ss.

[11] Solitamente la nozione di Big Data è enucleata attraverso le caratteristiche di tali datasets, in particolare (i) volume, (ii) velocità, (iii) varietà, (iv) veracità e (v) valore H. VARIAN, Big Data: New Tricks for Econometrics, in Journal of Economic Perspectives, 28, 2014, p. 3; A. GIANNACCARI, La storia dei Big Data, tra riflessioni teoriche e primi casi applicativi, in Mercato concorrenza regole n. 2/2017, pp. 307 e ss.; D. LANEY, 3D Data Management: Controlling Data Volume, Velocity and Variety, in Meta Group Research Note, 2001, 6 (70), p. 1. Sul punto cfr. anche M.E. STUCKE, A.P. GRUNES, Big Data and Competition Policy, Oxford University Press, 2016, https://global.oup.com/academic/product/big-data-and-competitionpolicy9780198788133?cc=fr&lang=en&.

[12] D. LANEY, 3-D data management: controlling data volume, velocity and variety, 2001, https://blogs.gartner.com/doug-laney/files/2012/01/ad949-3D-Data-Management-Controlling-Data-Volume-Velocity-and-Variety.pdf;

[13] Cfr. Comunicazione della Commissione al Parlamento Europeo, al Consiglio, al Comitato Economico e Sociale Europeo e al Comitato delle Regioni, Strategia per il mercato unico digitale in Europa, {SWD(2015) 100 final}, consultabile all’indirizzo https://eur-lex.europa.eu/legal-content/EN/TXT/?uri=celex%3A52015DC0192; C. BUZZACCHI, La politica europea per i big data e la logica del single market: prospettive di maggiore concorrenza?, in Concorrenza e mercato, 2016, p. 153. Cfr. anche il primo Report congiunto, redatto nel maggio 2016 dalle Autorità antitrust francese e tedesca, “Competition Law and Data”, consultabile all’indirizzo http://www.bundeskartellamt.de/SharedDocs/Publikation/DE/Berichte/Big%20Data%20Papier.pdf?__blob=publicationFile&v=2. A livello nazionale, invece, il recente Report congiunto redatto dall’Agcom, dall’Agcm e dal Garante per la protezione dei dati personali, conferma l’impatto trasversale del fenomeno dei Big Data: IC53 – Big Data, Indagine sui Big Data del 10 febbraio 2020, consultabile all’indirizzo https://www.agcm.it/dotcmsdoc/allegati-news/IC_Big%20data_imp.pdf.

[14] Y. KATZ, Manufacturing an Artificial Intelligence Revolution, 2017, p. 1. Disponibile in SSRN: https://ssrn.com/abstract=3078224. Secondo l’A., “the “AI” label has been rebranded to promote a vision of world governance through big data”.

[15] J. KLEINBERG, H. LAKKARAJU, J. LESKOVEC, J. LUDWIG, S. MULLIANATHAN, Human Decisions and Machine Predictions, in Quarterly Journal of Economics, 2017, p. 237.

[16] C. COGLIANESE, D. LEHR, Regulating by Robot: Administrative Decision Making in the Machine-Learning Era, 105 Geo. L.J. 1147; O. TENE, J. POLONETSKY, Taming the golem: challenges of ethical algorithmic decision-making, 19 N.C. J.L. & Tech. 125 (2017).

[17] Cfr. A.G. FERGUSON, The Rise of Big Data Policing. Surveillance, Race, and the Future of Law Enforcement, New York University Press, 2017. Cfr. Anche A. BABUTA, Big Data and Policing. An Assessment of Law Enforcement Requirements, Expectations and Priorities, in Royal United Services Institute for Defence and Security Studies, 2017.

[18] K. BRENNAN-MARQUEZ, Big Data Policing and the Redistribution of Anxiety, in Ohio State Journal of Criminal Law, 2018, p. 487.

[19] Come affermato da K. Brennan-Marquez, tali politiche ingenerano “a social order — a surveillance society — in which people constantly monitor and curate the data-trails they leave behind in everyday life”.

[20] Celebre è il caso del sistema COMPAS (Correctional Offender Management Profiling for Alternative Sanctions): sul punto cfr. State v. Loomis, 881 N.W.2d 749 (2016) 754 (USA).

[21] Il concetto di sicurezza urbana integrata è stato pienamente introdotto con il decreto legge 14/2017, successivamente convertito nella legge 48/2017, Conversione in legge, con modificazioni, del decreto-legge 20 febbraio 2017, n. 14, recante Disposizioni urgenti in materia di sicurezza delle città, pubbl. in GU Serie Generale n.93 del 21-04-2017.

[22] Decreto legge 14 giugno 2019, n. 53, recante “Disposizioni urgenti in materia di ordine e sicurezza pubblica”, pubbl. in GU Serie Generale n.138 del 14-06-2019. Per un approfondimento sul Decreto – legge cfr. A. ALGOSTINO, Sicurezza urbana, decoro della “smart city” e poteri del prefetto. Note intorno alla “Direttiva Salvini sulle zone rosse” (n. 11001/118/7 del 17 aprile 2019) ed alcune recenti ordinanze dei prefetti di Bologna, Firenze e Siracusa, in Costituzionalismo.it, 2019, fasc. 1, pt. 3, pp. 105-130.

[23] Si veda: G.G. NOBILI, T.F. GIUPPONI, E. RICIFARI, N. GALLO (a cura di), La sicurezza delle città. La sicurezza urbana e integrata, Milano, 2019.

[24] Sul punto cfr. G. PIGHI, Spazi e destinatari delle politiche di sicurezza urbana: la città divisa, in Diritto penale e processo n.11/2019, pp. 1518-1530. Secondo l’A. per “resilienza delle città” deve intendersi una “caratteristica del sistema urbano che lo protegge dai fattori critici e favorisce il recupero degli equilibri originari con l’azione quotidiana di prevenzione, interventi organizzati, servizi, controlli e la vigilanza sul territorio”: la definizione è fornita da United Nations, Prague declaration for habitat III Europe regionalmeeting, Prague, 16-18march 2016, in http://www.mmr.cz. Per un ulteriore confronto sul punto, si veda S. D’Antonio, Verso Habitat III, la Dichiarazione di Praga promuove la visione europea sullo sviluppo urbano sostenibile, in Enti locali & Pa, Il Sole XXIV ore, 25 marzo 2016.

[25] Si veda: M. PAVARINI, Sicurezza dalla criminalità e governo democratico della città, in Studi in onore di Giorgio Marinucci, Volume 1, Milano, 2006, 1039 ss.

[26] È il caso del software Key Crime, adoperato sin dal 2014 dalla Polizia di Stato. Sul punto si https://www.poliziadistato.it/statics/16/la-chiave-del-crimine.pdf

[27] Sul punto si rimanda a M. PALMIRANI, Big Data e conoscenza, in Rivista di filosofia del diritto n. 1/2020, pp. 73 e ss.

[28] R. MATHEUS, Data science empowering the public: Data-driven dashboards for transparent and accountable decision-making in smart cities, cit. che R. Simmons, Big Data, Machine Judges, and the Legitimacy of the Criminal Justice System, inU.C.D. L. Rev., 2018, p. 1067.

[29] Direttiva (UE) 2016/680 del Parlamento europeo e del Consiglio, del 27 aprile 2016, relativa alla protezione delle persone fisiche con riguardo al trattamento dei dati personali da parte delle autorità competenti a fini di prevenzione, indagine, accertamento e perseguimento di reati o esecuzione di sanzioni penali, nonché alla libera circolazione di tali dati e che abroga la decisione quadro 2008/977/GAI del Consiglio

Biografia

Alessia PALLADINO, Dottore di ricerca in Humanities and Technologies: an integrated research path Università degli studi Suor Orsola Benincasa Napoli

Dottore di ricerca in Humanities and Technologies: an integrated research path presso l’Università degli Studi Suor Orsola Benincasa di Napoli, ove attualmente è cultore della materia in Diritto amministrativo. Avvocato e membro del network DirICTo, ha ricoperto incarichi in qualità di esperto giuridico in Digitalizzazione, Smart cities e Big Data. Ha relazionato su tali temi nei convegni ICONS Firenze, EPLO, Confindustria Sardegna Meridionale e presso il CNEL ed è autrice di pubblicazioni scientifiche pertinenti.